一文读懂Adam优化算法 - 知乎

May 9, 2024 · 自从 梯度下降 (Gradient Descent)算法诞生以来,众多变体被提出,以适应不同的需求和场景。 其中, Adam(Adaptive Moment Estimation)算法 因其高效和强大的性能成为了深度学 …

深入剖析 Adam 优化器:原理、优势与应用 - 知乎

在深度学习领域,优化器的选择对模型的训练效率和性能起着决定性作用。 Adam优化器作为一种自适应优化算法,凭借其根据历史梯度信息动态调整学习率的特性,备受研究者和工程师的青睐。 它巧妙 …

PyTorch模型训练优化器Adam和AdamW - 知乎

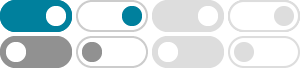

Adam 是一种结合了 Momentum动量思想 (利用累加历史梯度信息更新梯度,减少震荡,加速通往谷底) 和 RMSProp自适应学习率思想 (记录各个参数方向上的 梯度 的振荡幅度,振荡幅度越大,更新的 …

优化算法三剑客:SGD、Adam、AdamW的深度对比

优化算法三剑客:SGD、Adam、AdamW的深度对比 1. 引言:模型训练的"导航系统" 想象一下,你正在一个复杂的地形中寻找最低点(最小损失),四周浓雾弥漫(高维空间不可视)。 优化算法就是你 …

Adam 优化器背后的数学原理 - 知乎

为什么 Adam 是深度学习中最受欢迎的优化器? 让我们通过深入了解其数学原理,并重新创建算法来理解它。 Adam,这个名字在许多获奖的 Kaggle 竞赛中广为人知。 参与者尝试使用几种优化器(如 …

Adam和AdamW - 知乎 - 知乎专栏

AdamW目前是大语言模型训练的默认优化器,而大部分资料对Adam跟AdamW区别的介绍都不是很明确,在此梳理一下Adam与AdamW的计算流程,明确一下二者的区别。

如何理解Adam算法 (Adaptive Moment Estimation)? - 知乎

我们组刚中的一篇 ICML2022 Oral 的论文就是从动力学角度理论分析了Adam,特别是Adam相对于SGD的优劣之处。 一句话结论: Adam逃离鞍点很快,但是不能像SGD一样擅长寻找泛化好的flat …

NeurIPS 2025 oral :揭开 Adam 成功的秘密 - 知乎

Dec 30, 2025 · 平时调 Adam 超参的时候,一般都习惯性把 beta1 设成 0.9,beta2 设成 0.95 或者 0.999。 但这篇论文给出了一个非常反直觉的结论: 把 beta1 和 beta2 设成相等的值,才是接近最 …

PyTorch中的torch.optim.Adam优化器 - 知乎

基本原理 Adam本质上是一个优化器,用于优化模型的参数。 这样的优化步骤可以由以下公式描述: θ t = θ t 1 η m ^ t v ^ t + ϵ ,其中 η 为初始学习率, ϵ 为数值稳定常数,说白了是用于防止除零异常。 关 …

Who’s Adam?最逆天的NeurIPS评审出炉了 - 知乎

Jul 25, 2025 · 审稿人意见如下: 两个架构都使用 Adam 优化。 「Adam」 是谁 / 是什么? 我认为这是一个非常严重的拼写错误,作者本应在投稿前删除。 没错,这正是Lu老师NeurIPS论文的评审意见。 …